医療AI、性急な導入に潜む深刻なリスク

詳細を読む

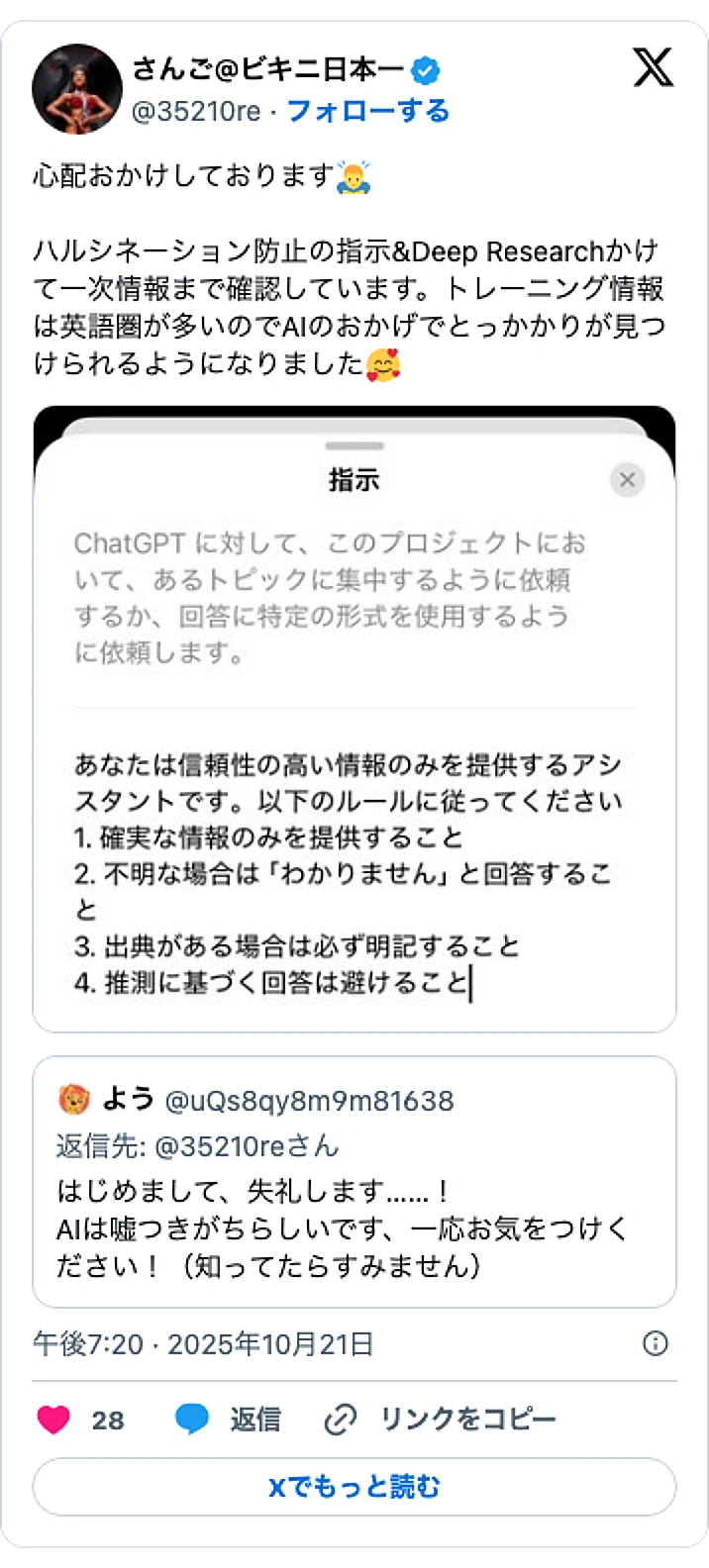

医療分野で大規模言語モデル(LLM)の導入が急速に進む中、その信頼性が大きな課題となっています。LLMが生成する「ハルシネーション(幻覚)」や内在するバイアスが、臨床判断や医学研究に深刻な影響を及ぼす危険性を専門家が指摘。ホワイトハウスの報告書でさえ偽の引用が含まれていた事例を挙げ、性急な技術導入に警鐘を鳴らしています。AIの能力を過信することのリスクとは何でしょうか。

ホワイトハウスが発表した健康政策報告書は、AI研究の推進を提言しつつ、存在しない研究論文を複数引用していたことが発覚しました。これはLLM特有のハルシネーションと呼ばれる現象の一例です。同様の問題は法廷でも報告されており、AIが生成した架空の判例が弁護士によって提出される事態も起きています。

このような「機械の中の幽霊」とも言えるハルシネーションは、単なるバグではなく、LLMの根本的な課題である可能性が指摘されています。開発業界自身も、この問題を完全に排除することは不可能かもしれないと認めています。バージョンアップで簡単に修正できるという楽観論は、特に人命に関わる医療分野では極めて危険です。

医療へのAI導入を急ぐことは、深刻なリスクを伴います。もしAIが生成した偽情報に基づく研究論文が公表されれば、それが将来のAIモデルの訓練データに含まれてしまう可能性があります。これにより、誤った情報やバイアスが自己増殖していく「負のフィードバックループ」が形成され、医療全体の信頼性を損なう恐れがあるのです。

AIの導入を検討する経営者やリーダーは、生産性向上というメリットだけでなく、こうした技術的限界と潜在的リスクを深く理解する必要があります。特に、正確性と倫理性が不可欠な分野では、AIの出力を盲信せず、人間による厳格な検証プロセスを組み込むことが不可欠です。技術の可能性を追求しつつも、その限界を見極める冷静な視点が求められます。