中国発MiniMax-M2、オープンソースLLMの新王者

詳細を読む

中国のAIスタートアップMiniMaxが27日、最新の大規模言語モデル(LLM)「MiniMax-M2」を公開しました。第三者機関の評価でオープンソースLLMの首位に立ち、特に自律的に外部ツールを操作する「エージェント性能」で独自モデルに匹敵する能力を示します。商用利用可能なライセンスと高い電力効率を両立し、企業のAI活用を加速させるモデルとして注目されます。

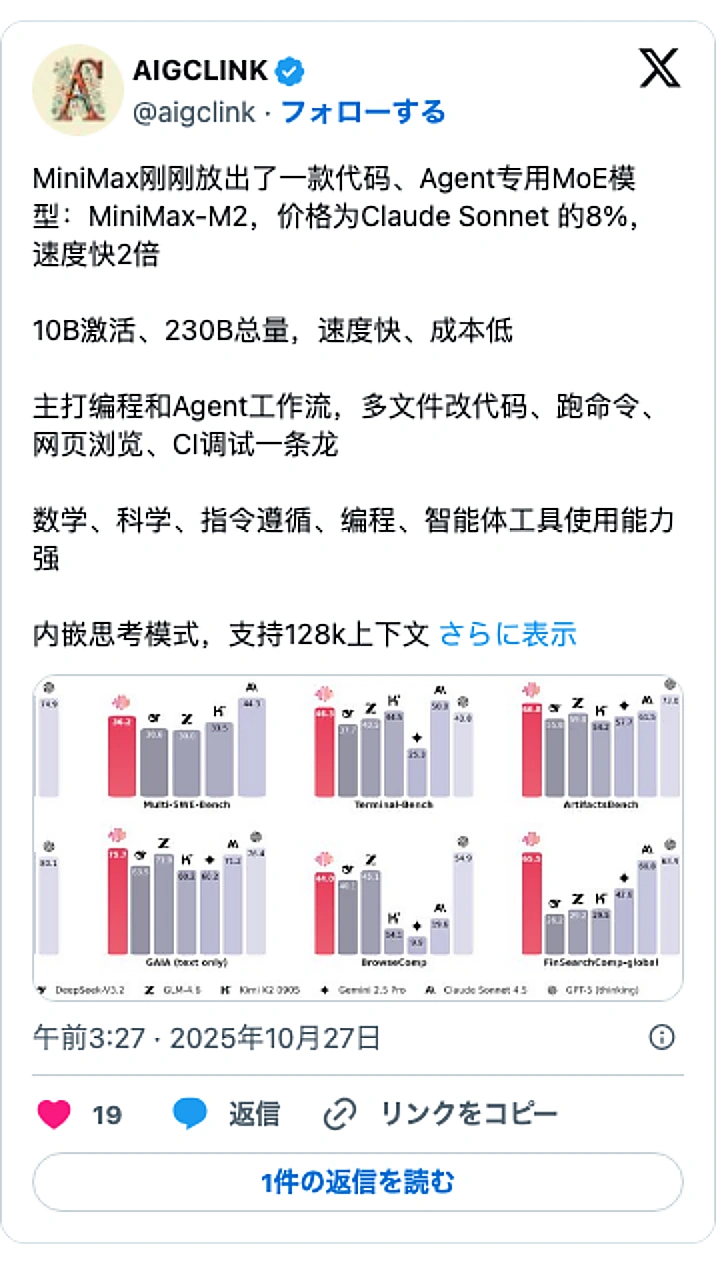

第三者評価機関Artificial Analysisの総合指標で、MiniMax-M2はオープンソースLLMとして世界1位を獲得しました。特に、自律的な計画・実行能力を測るエージェント関連のベンチマークでは、GPT-5やClaude Sonnet 4.5といった最先端の独自モデルと肩を並べるスコアを記録。コーディングやタスク実行能力でも高い性能が確認されています。

M2の最大の特長は、企業での導入しやすさです。専門家の知識を組み合わせる「MoE」アーキテクチャを採用し、総パラメータ2300億に対し、有効パラメータを100億に抑制。これにより、わずか4基のNVIDIA H100 GPUでの運用を可能にし、インフラコストを大幅に削減します。さらに、商用利用を認めるMITライセンスは、企業が独自に改良・展開する際の障壁を取り払います。

高いエージェント性能を支えるのが、独自の「インターリーブ思考」形式です。モデルの思考プロセスがタグで明示されるため、論理の追跡と検証が容易になります。これは、複雑なワークフローを自動化する上で極めて重要な機能です。開発者は構造化された形式で外部ツールやAPIを連携させ、M2を中核とした高度な自律エージェントシステムを構築できます。

M2の登場は、オープンソースAI開発における中国勢の台頭を象徴しています。DeepSeekやアリババのQwenに続き、MiniMaxもまた、単なるモデルサイズではなく、実用的なエージェント能力やコスト効率を重視する潮流を加速させています。監査や自社でのチューニングが可能なオープンモデルの選択肢が広がることは、企業のAI戦略に大きな影響を与えるでしょう。