スパースモデルでAIの思考回路を可視化

詳細を読む

AI開発をリードするOpenAIが、AIモデルの意思決定プロセスを解明する新手法「スパースモデル」に関する研究成果を発表しました。この技術は、AI内部の複雑な接続を単純化することで、なぜAIがその結論に至ったのかを分析しやすくするものです。企業のAI導入における「ブラックボックス」問題の解決に繋がり、信頼性の高いAI活用を後押しする可能性を秘めています。

なぜAIの「思考」を理解する必要があるのでしょうか。現在のAIモデルは、人間が解読困難なほど複雑な内部接続を持ち、その意思決定プロセスは不透明です。この「ブラックボックス」状態は、予期せぬ誤動作の原因特定を困難にし、企業が重要な業務にAIを導入する上での大きな障壁となっていました。モデルの挙動を説明できなければ、監督や改善もままなりません。

OpenAIが注目したのが「スパース(疎な)モデル」です。従来のモデルが持つ膨大な神経回路(接続)を意図的に大幅削減し、まばらな状態にします。これにより、特定のタスクを実行する際にどの回路が活動しているのかを追跡しやすくなります。複雑に絡み合った糸をほぐすように、AIの思考経路を一つひとつ解き明かすアプローチと言えるでしょう。

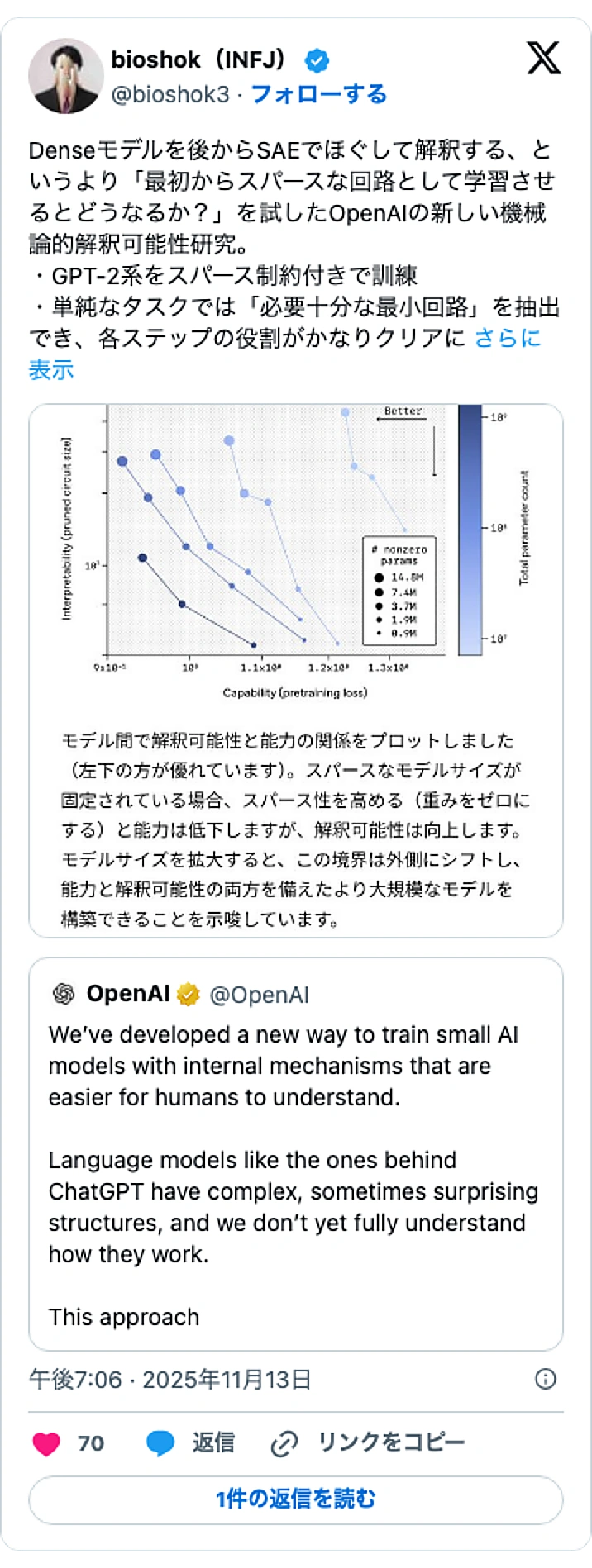

研究チームは、GPT-2に似た構造のモデルで実験を行い、その有効性を確認しました。スパースモデルを分析した結果、従来の密なモデルに比べて約16分の1のサイズの回路で、特定のタスクを担う部分を特定できたと報告しています。これは、モデルの挙動をより少ない要素で、かつ正確に説明できるようになったことを意味します。

今回の成果は比較的小規模なモデルでのものですが、将来的にはGPT-5.1のような最先端大規模モデルへの応用が期待されます。AIの解釈可能性向上は業界全体の重要課題であり、Anthropic社やMeta社も同様の研究を進めています。AIをより安全で信頼できるツールとして社会に実装していく上で、不可欠な研究開発と言えるでしょう。