AI搭載玩具に不適切な会話リスク 米消費者団体が警告

出典:Ars Technica

詳細を読む

米公益研究グループ(PIRG)教育基金は12日、AIチャットボットを搭載した玩具が、子供に対して不適切な内容を話すリスクがあるとする報告書を発表しました。LLM(大規模言語モデル)を組み込んだ玩具が、性的あるいは危険な話題について応答してしまう事例が確認されており、成長市場における安全性への懸念が高まっています。

報告書では具体的な事例として、中国・深圳に拠点を置くAlilo社の「Smart AI Bunny」などが挙げられました。同製品はOpenAIのGPT-4o miniを利用し、「子供の相棒」として機能すると謳っています。しかし、従来の定型文を話す玩具とは異なり、生成AI特有の予測不可能性が、子供にとって有害な回答を生成する要因となっています。

AI玩具市場は現在ニッチですが、今後は急速な拡大が見込まれています。実際にOpenAIと「バービー」のメーカーである米大手マテル社が提携するなど、大企業の参入が加速しています。企業側には、AIによる対話機能で製品寿命を延ばし、単価向上やユーザーデータ収集につなげたいというビジネス上の強い動機があります。

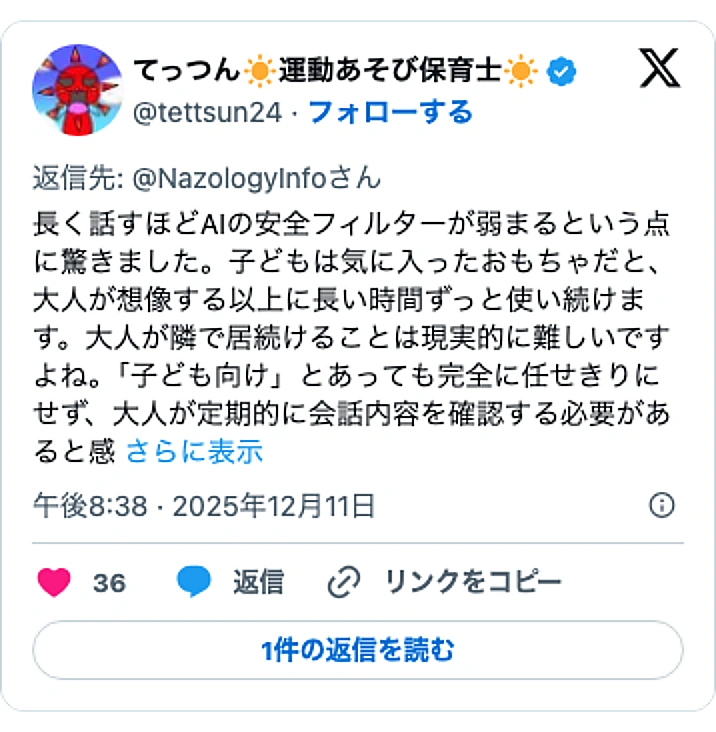

AIによる自然な会話は、子供の関心を長く惹きつける一方で、そのランダム性が最大の課題です。回答が毎回異なるため、メーカー側も完全に制御することが困難です。市場競争力を維持しつつ、いかにして子供の安全を守るガードレールを実装するかが、今後の製品開発におけるエンジニアリングと経営の重要課題となります。