詳細を見る

中国のDeepSeekは2025年12月1日、米国のGPT-5やGemini 3.0に匹敵する新モデル「DeepSeek-V3.2」を公開しました。MITライセンスでの無料公開であり、圧倒的な性能と低コストでAI業界の勢力図を塗り替えようとしています。

本モデルの核心は、「DeepSeek Sparse Attention」と呼ばれる新技術です。必要な情報のみを抽出処理することで、長文脈の処理においても推論コストを約70%削減し、100万トークンあたり0.70ドルという驚異的な安さを実現しました。

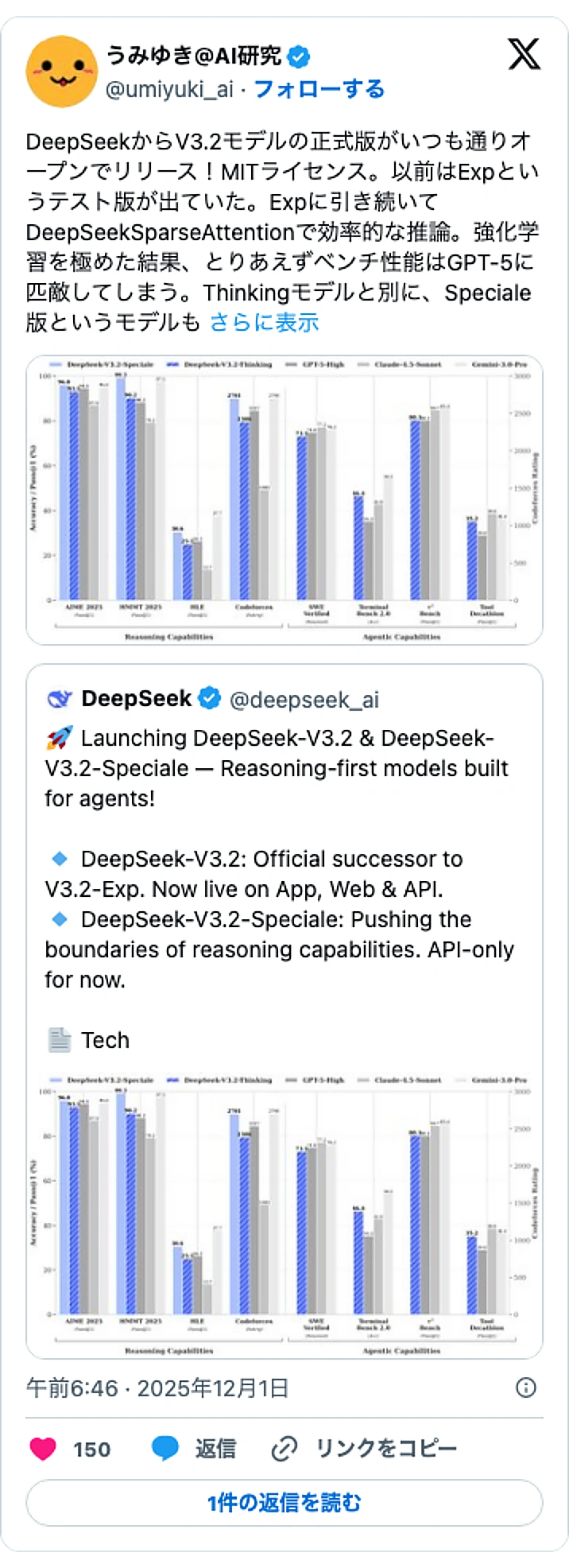

性能面でも世界最高水準に到達しました。特に推論特化型の「Speciale」は、国際数学オリンピックやコーディング課題において金メダル級のスコアを記録し、一部のベンチマークではGPT-5やGeminiを凌駕する結果を残しています。

実務面での革新は「ツール使用中の思考維持」です。検索やコード実行を行う際も思考プロセスを途切れさせないため、複雑な課題解決が可能です。これにより、エンジニアは高度なAIエージェントをより安価に構築できるようになります。

今回のリリースは、米国の輸出規制下でも中国が最先端AIを開発できることを証明しました。高性能モデルの無償公開は、高額なAPI利用料に依存する既存のビジネスモデルを根底から揺るがす、極めて戦略的な一手といえます。